No todo ensayo clínico fase 3 es pivotal

Por Maicel Monzón

En investigación clínica hay palabras que no describen: condicionan.

“Fase 3” es una de ellas.

Actúa como un sello de madurez y credibilidad. En cuanto aparece, muchos dejan de cuestionar el protocolo y empiezan a asumir que el estudio es robusto. Ese atajo mental es cómodo, pero con demasiada frecuencia es falso.

La etiqueta no confirma nada

La fase de un ensayo describe cuándo ocurre en el desarrollo clínico de un producto farmacológico.

No describe qué tan bien responde a la pregunta científica que plantea la investigación.

Llamar “confirmatorio” a un estudio porque está en fase 3 es una afirmación administrativa, no inferencial.

Un estudio solo confirma algo si su diseño le permite:

- aislar el efecto del tratamiento,

- mitigar fuentes relevantes de sesgo,

- y sostener una inferencia causal defendible.

Si eso no está presente, el estudio puede producir resultados.

Pero no necesariamente evidencias sólidas.

Sin comparación, no hay efecto demostrable

La capacidad de un estudio para establecer causalidad depende de su estructura comparativa.

Sin un grupo de referencia adecuado, lo que observamos puedes ser el resultado de la evolución natural de la enfermedad, no un efecto causal.

Un estudio puede mostrar qué ocurre bajo tratamiento.

Pero la pregunta relevante es otra:

¿qué habría ocurrido en ausencia del tratamiento?

Sin ese contrafactual, hablar de efecto es una extrapolación especulativa.

No una estimación rigurosa.

Cuando el “fase 3” pierde capacidad inferencial

Esto no es un problema teórico.

Existen ensayos presentados como fase 3 que:

– carecen de comparador concurrente,

– utilizan controles históricos o externos,

– estiman el efecto del tratamiento a partir de desenlaces vulnerables a sesgos de medición, adjudicación o análisis,

– o se basan en análisis sin una hipótesis primaria claramente preespecificada.

En estos escenarios, el problema no es que el estudio sea “menos ideal”.

Es que no está en condiciones de sostener una inferencia causal robusta.

Y eso no se corrige con:

- incluyendo más pacientes,

- incorporando más sitios clínicos,

- dando más tiempo de seguimiento,

- o una etiqueta más avanzada.

El problema de los controles que no controlan

No todos los “controles” cumplen la misma función.

La aleatorización es el mecanismo que, en expectativa, balancea factores conocidos y no observados entre grupos.

Un comparador concurrente no aleatorizado puede mejorar la comparabilidad temporal y de medición, pero no garantiza control de la confusión.

Un control histórico o externo carece tanto de aleatorización como de concurrencia.

Cuando se recurre a datos externos:

- la población puede no ser intercambiable,

- los criterios de selección pueden diferir,

- la medición de los desenlaces puede no ser consistente,

- y la estimación del efecto puede estar afectada por confusión no medida y sesgo de selección.

Esto no solo introduce incertidumbre.

Introduce sesgo estructural, con frecuencia en dirección favorable al tratamiento.

En ese contexto, un resultado positivo deja de ser confirmatorio y pasa a ser intrínsecamente difícil de interpretar.

Aquí tienes una reescritura más rigurosa, breve y metodológicamente sólida, manteniendo tu idea pero con lenguaje estándar de evidencia clínica:

No es un error. Es una cuestión de diseño

Si estos problemas fueran excepcionales, serían errores.

No lo son.

Muchos ensayos no están optimizados exclusivamente para estimar el efecto causal en condiciones ideales, sino para equilibrar consideraciones científicas, operativas y regulatorias.

Esto puede reflejarse en:

- selección de poblaciones con mayor probabilidad de respuesta,

- uso de comparadores no óptimos o indirectos,

- elección de desenlaces sustitutos o parcialmente subjetivos,

- y estrategias analíticas con complejidad o flexibilidad no siempre plenamente preespecificada.

El resultado no implica necesariamente invalidez del estudio.

Pero sí puede implicar que la estimación del efecto esté afectada por sesgos sistemáticos derivados del diseño.

No es un problema de fraude ni de error aislado.

Es un problema de inferencias condicionadas por decisiones estructurales del diseño del ensayo.

La tensión regulatoria que casi no se discute

Las agencias regulatorias :— no aprueban productos farmacológicos por la fase del ensayo.

Aprueban por la existencia de evidencia sustancial de eficacia y seguridad demostrada, basada en estudios bien diseñados.

Sin embargo, en la práctica, la etiqueta “fase 3” tiende a funcionar como un atajo:

sugiere que el estudio es pivotal, incluso cuando su diseño no cumple plenamente con ese estándar.

Aquí aparece una tensión real:

- el lenguaje sugiere confirmación,

- pero la estructura puede no sostenerla.

El riesgo no es semántico.

Es regulatorio:

evaluar como evidencia confirmatoria lo que en realidad es evidencia limitada.

Cuando la aceptación implica incertidumbre (y no se dice)

Existen contextos muy específicos dónde aceptar evidencia limitada es razonable:

- enfermedades raras,

- necesidades médicas no cubiertas,

- vías aceleradas.

Pero en esos casos ocurre un cambio clave:

la decisión ya no se basa en confirmación robusta,

sino en gestión explícita de incertidumbre.

El problema es que esta transición no siempre se reconoce con claridad.

Y la etiqueta “fase 3” puede contribuir a ocultarla.

No todo lo que parece confirmatorio, confirma

Un estudio puede tener una muestra grande y ser multicéntrico.

Y aún así no responder con claridad la pregunta que plantea.

Porque el problema no es el tamaño.

Es la estructura.

Un estudio sin comparación adecuada no es un experimento incompleto.

Es otra cosa:

una observación estructurada incapaz de aislar el efecto del tratamiento.

Y ese límite no desaparece porque el estudio se llame fase 3.

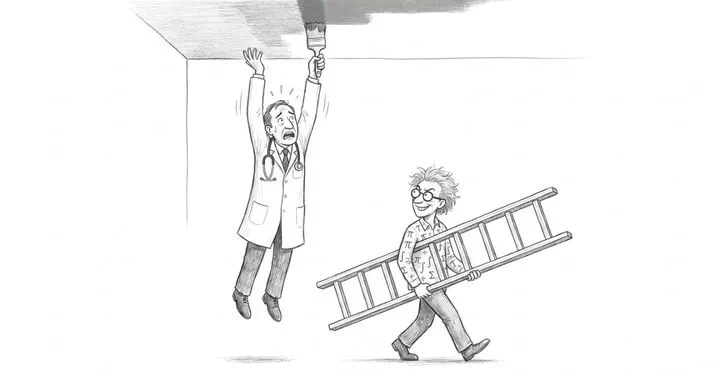

Cuando la fase 3 se vuelve narrativa

En algunos programas, la fase 3 no marca confirmación.

Marca legitimación.

- “la evidencia está madura”

- “la decisión está cerca”

Pero la cercanía regulatoria no sustituye la capacidad inferencial.

Llegar tarde no implica llegar bien.

Conclusión

Decir que un estudio es fase 3 es fácil.

Demostrar que realmente confirma algo es mucho más difícil.

La pregunta incómoda no es cuántos estudios llegan a fase 3.

Es cuántos de ellos seguirían pareciendo evidencia fuerte si elimináramos esa etiqueta.

Y una más:

si un estudio no puede permitirse perder el nombre “fase 3” sin perder credibilidad,

¿qué parte de su fortaleza proviene realmente de los datos?

La próxima vez que leas “fase 3”, no te preguntes en qué etapa está el estudio.

Pregúntate:

- ¿qué efecto está realmente estimando?

- ¿qué suposiciones sostienen ese resultado?

- ¿qué parte del argumento depende del diseño… y cuál de la etiqueta?

Porque en evaluación clínica, el problema no es cómo se llama el estudio.

Es lo que realmente puede demostrar.

Referencias

- ICH E9. Statistical Principles for Clinical Trials. International Council for Harmonisation, 1998.

- ICH E9(R1). Addendum on Estimands and Sensitivity Analysis. International Council for Harmonisation, 2019.

- ICH E10. Choice of Control Group and Related Issues in Clinical Trials. International Council for Harmonisation, 2000.

- Demonstrating Substantial Evidence of Effectiveness for Human Drug and Biological Products. 2019.

- Estimating Causal Effects of Treatments. 1974.

- Statistics and Causal Inference. 1986.

- Causal Inference: What If. 2020.

Relacionado

- Cuando la ética se usa para evitar el control

- Rituales metodológicos en ensayos clínicos: cuando la técnica reemplaza al pensamiento

- Ritual ITT/PP en Estudios No Aleatorizados: Desmontando un Mito

- El Frankenstein metodológico: desconexión inferencial entre fenómeno clínico y objetivos o hipótesis

- El Frankenstein metodológico: cuando la estadística responde otra pregunta